前 言

算法依托确定的输入输出过程,能够实现相较于自然人更为客观、理性和有效的决策。基于此,算法被人们依赖甚至信仰,借助算法解决问题成为超越人类认知局限和执行能力的更优选择,甚至有学者断言,我们正在逐步迈入一个围绕算法逻辑而组织和运转的“算法社会“。与此同时,算法从其诞生伊始,便带着“算法歧视”“黑箱”“易被操控”“信息茧房“等原罪以及由于其“不被解释”“无法救济”和“可问责性低”而产生的“算法暴政”,越来越多的声音呼吁将算法关进“法治的牢笼”。

有鉴于此,2021年12月31日,国家互联网信息办公室、工业和信息化部、公安部、国家市场监管总局联合发布《互联网信息服务算法推荐管理规定》(以下简称《算法规定》),该《算法规定》自2022年3月1日起施行。《算法规定》设置了更清晰的监督管理体制、更明确的算法推荐服务提供者义务以及更全面的用户权益保护三个维度以回应公众对于算法的担忧。本文拟简要分析通过《算法规定》构建的提升算法透明度的体系。

基于技术鸿沟、商业秘密以及认知不足等原因,算法的运作带有一定不透明性,监管部门、社会公众和平台用户难以洞悉算法运作的机理,无形中增加了外在监督难度[1]以及内在的不信任。由北京大学互联网发展研究中心与互联网公司联合发布的《中国大安全感知报告(2021)》显示,有七成受访者感到算法能获取自己的喜好、兴趣从而“算计”自己,近五成受访者表示在算法束缚下想要逃离网络、远离手机。[2]对于算法的信任危机正是我们需要解决的迫在眉睫的问题。算法的黑箱操作让监管部门、公众以及用户难以建立起对于算法的有效监督以及对于算法的信任,更不用说有效行使用户的自由选择权以及公平交易权了。我国《关于加强互联网信息服务算法综合治理的指导意见》第十三条就对算法的透明度提出要求,“推动算法公开透明。规范企业算法应用行为,保护网民合理权益,秉持公平、公正原则,促进算法公开透明。督促企业及时、合理、有效地公开算法基本原理、优化目标、决策标准等信息,做好算法结果解释,畅通投诉通道,消除社会疑虑,推动算法健康发展。”为落实上述公开透明的原则并解决算法信任危机,《算法规定》从基本原则、用户知情权和算法推荐服务提供者解释义务、用户个体私权利和公权力介入算法决策权三个角度提出了解决方案。

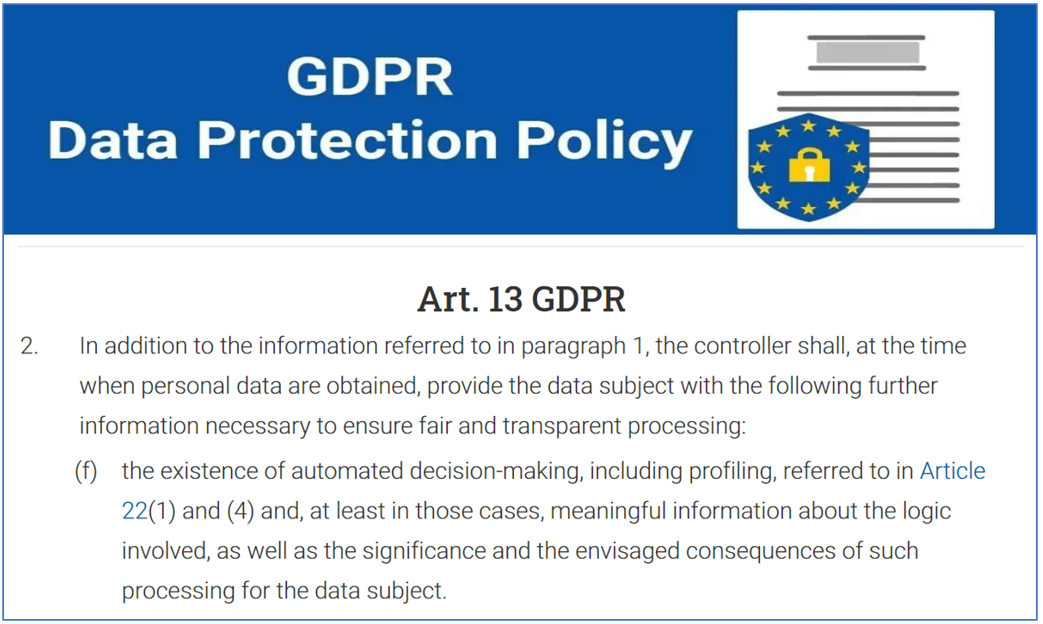

GDPR

[1] 中国信息通信研究院政策与经济研究所/新华网大数据中心,《算法治理蓝皮书》,2022年。

[2] 南方周末,《互联网信息服务算法推荐管理规定》明日起正式施行,2月28日。

[3] 丁晓东,《基于信任的自动化决策:算法解释权的原理反思与制度重构》,《中国法学》2022年。

邦信阳中建中汇 | 田小丰律师入选《商法》The A-List法律精英 : 2021年100位“中国法执业优秀律师”

邦信阳中建中汇合伙人田小丰律师荣膺“2021年度LEGALBAND客户首选:合规多面手15强”